Acercando un tiburón generado con IA a un tiburón real

Hubo un tiempo en que los tiburones solo vivían en el océano. Hoy en día, con el crecimiento exponencial de las capacidades de la IA, se pueden generar en segundos. Detallados. Temibles. Pero llevarlos a aplicaciones reales no es tan simple como escribir un prompt. Cuando se trata de integrar IA generativa en un producto, gran cantidad de restricciones entran en juego y también variables con las que poder trabajar. Este artículo explora el uso de imágenes generadas con IA en productos reales, con especial énfasis en los desafíos, variables y posibilidades involucradas. Los ejemplos se centran en aplicaciones en las que la generación de imágenes en tiempo real es esencial para proporcionar experiencias personalizadas a cada usuario: juegos o recomendaciones entre otros.

.png)

Esqueleto de Tiburón

Tecnología

Antes de profundizar en las variables que afectan al resultado, haremos un recorrido por algunas metodologías clave detrás de la generación de imágenes, cada una con un enfoque, ventajas y limitaciones diferentes:

Generative Adversarial Networks (GAN)

Basado en dos modelos, un generador que crea muestras falsas a partir de una entrada y un discriminador que decide si una muestra es real, a partir de los datos de entrenamiento, o generada y falsa. El generador mejora su salida para engañar al discriminador y que la clasifique como reales las muestras falsas. A partir de cada resultado, el generador y el discriminador mejoran su comportamiento.

Modelos autorregresivos

Estos modelos generan imágenes de forma secuencial, donde cada sección, como un píxel o una región, depende de las generadas anteriormente. Esto permite resultados detallados, pero a menudo requiere más potencia de procesamiento para imágenes complejas.

Modelos de difusión

Estos modelos se entrenan agregando ruido a los datos de la imagen y luego aprendiendo a revertir ese proceso, reconstruyendo los datos a partir del ruido. Cuando se utiliza un modelo de difusión de imágenes a partir de un prompt de texto, se convierte éste en un embedding, una representación matemática del mismo, que guía el proceso de eliminación de ruido, paso a paso, que aprendió en la fase de entrenamiento.

Antes de profundizar en las variables que afectan al resultado, haremos un recorrido por algunas metodologías clave detrás de la generación de imágenes, cada una con un enfoque, ventajas y limitaciones diferentes:

Generative Adversarial Networks (GAN)

Basado en dos modelos, un generador que crea muestras falsas a partir de una entrada y un discriminador que decide si una muestra es real, a partir de los datos de entrenamiento, o generada y falsa. El generador mejora su salida para engañar al discriminador y que la clasifique como reales las muestras falsas. A partir de cada resultado, el generador y el discriminador mejoran su comportamiento.

Modelos autorregresivos

Estos modelos generan imágenes de forma secuencial, donde cada sección, como un píxel o una región, depende de las generadas anteriormente. Esto permite resultados detallados, pero a menudo requiere más potencia de procesamiento para imágenes complejas.

Modelos de difusión

Estos modelos se entrenan agregando ruido a los datos de la imagen y luego aprendiendo a revertir ese proceso, reconstruyendo los datos a partir del ruido. Cuando se utiliza un modelo de difusión de imágenes a partir de un prompt de texto, se convierte éste en un embedding, una representación matemática del mismo, que guía el proceso de eliminación de ruido, paso a paso, que aprendió en la fase de entrenamiento.

.png)

Dientes de Tiburón

Al principio trabajar con texto era la forma más accesible y efectiva de interactuar con los modelos generativos. Sin embargo, los avances en capacidades como la multimodalidad han abierto nuevas posibilidades, permitiendo que los modelos comprendan y generen utilizando no solo texto, sino también imágenes, audio y más. Ahora son capaces de usar todos los sentidos a la vez.

Es importante conocer la tecnología detrás de los modelos que usamos además de las variables y características concretas de éstos, para entender por qué suceden determinados comportamientos: alucinaciones, tiempos de generación más altos o bajos, precios mayores, o resultados más o menos precisos entre otros. Pero también para conocer con qué variables tenemos la posibilidad de trabajar una vez escogemos el modelo.

Variables

Un análisis detallado de las variables puede significar la diferencia a la hora de construir un producto consistente con una sólida experiencia de usuario.

Es importante conocer la tecnología detrás de los modelos que usamos además de las variables y características concretas de éstos, para entender por qué suceden determinados comportamientos: alucinaciones, tiempos de generación más altos o bajos, precios mayores, o resultados más o menos precisos entre otros. Pero también para conocer con qué variables tenemos la posibilidad de trabajar una vez escogemos el modelo.

Variables

Un análisis detallado de las variables puede significar la diferencia a la hora de construir un producto consistente con una sólida experiencia de usuario.

.png)

Cola de Tiburón

Tiempo

Actualmente, los modelos emplean al menos unos segundos en generar imágenes. Menos tiempo significa mayor precio por imagen o una calidad más baja. A veces será crucial para experiencias en tiempo real un tiempo de generación muy reducido, pero otras, el producto puede permitirse una generación de imágenes más larga, y podemos reducir la percepción de espera de los usuarios a través del diseño. Estos son algunos consejos:

. Utilizar animaciones o cambiar el foco a otros elementos mientras los usuarios esperan.

. No saturar estados de carga si los usuarios los van a ver con frecuencia.

. Mostrar contadores o textos cambiantes que transmitan que el sistema está funcionando.

. Si el proceso de generación se divide en diferentes etapas, utilizarlo para dar información de progreso real.

Formato

El formato cuadrado es generalmente más barato que los horizontales o verticales porque se debe generar un área más pequeña. Para miles de usos, esta diferencia se vuelve significativa. Es importante evaluar si el producto realmente requiere un formato específico o si la API proporciona diferentes resoluciones. Por ejemplo, los modelos autorregresivos necesitan generar más zonas, mientras que los de difusión requieren pasadas más amplias para formatos mayores, lo que afecta tanto a los parámetros como a los recursos necesarios.

Actualmente, los modelos emplean al menos unos segundos en generar imágenes. Menos tiempo significa mayor precio por imagen o una calidad más baja. A veces será crucial para experiencias en tiempo real un tiempo de generación muy reducido, pero otras, el producto puede permitirse una generación de imágenes más larga, y podemos reducir la percepción de espera de los usuarios a través del diseño. Estos son algunos consejos:

. Utilizar animaciones o cambiar el foco a otros elementos mientras los usuarios esperan.

. No saturar estados de carga si los usuarios los van a ver con frecuencia.

. Mostrar contadores o textos cambiantes que transmitan que el sistema está funcionando.

. Si el proceso de generación se divide en diferentes etapas, utilizarlo para dar información de progreso real.

Formato

El formato cuadrado es generalmente más barato que los horizontales o verticales porque se debe generar un área más pequeña. Para miles de usos, esta diferencia se vuelve significativa. Es importante evaluar si el producto realmente requiere un formato específico o si la API proporciona diferentes resoluciones. Por ejemplo, los modelos autorregresivos necesitan generar más zonas, mientras que los de difusión requieren pasadas más amplias para formatos mayores, lo que afecta tanto a los parámetros como a los recursos necesarios.

.png)

Columna de Tiburón

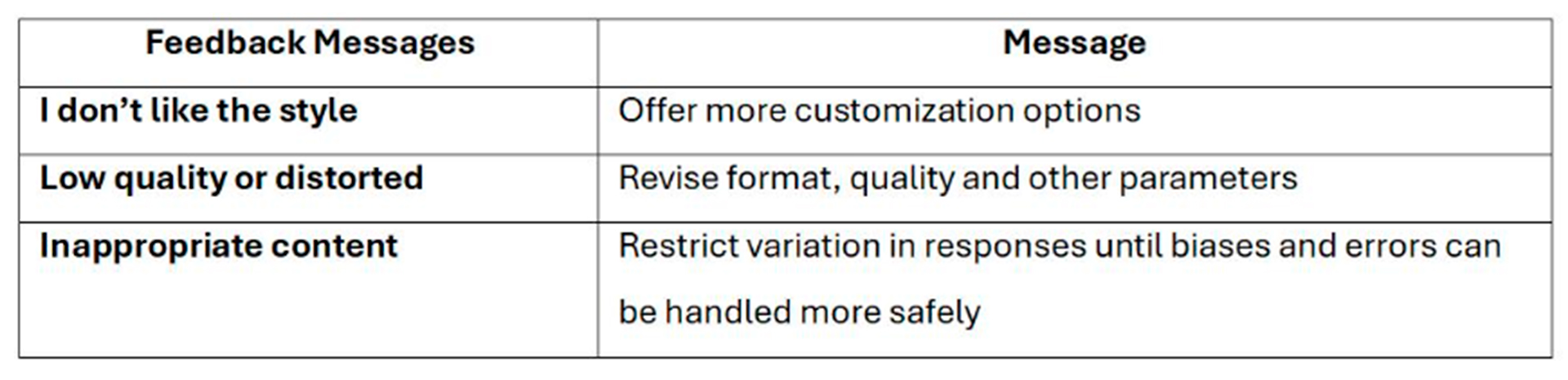

Emplea el

feedback de los usuarios para entender su percepción de las imágenes. Si lo ven como algo innovador o, al contrario, causa rechazo y afecta negativamente a tu producto. Esto te ayudará a detectar sesgos, contenido inapropiado o mejoras posibles en los modelos o respuestas. A continuación puedes ver algunos ejemplos:

Tabla ejemplos

Precio

No podemos hablar de productos reales sin mencionar el presupuesto disponible. La generación de imágenes es más cara que la generación de texto entre otros. Algunos consejos que puedes aplicar:

. Implementar límites de uso diario por usuario.

. Ofrece planes de pago.

. Implementar límites para detener usos fraudulentos

Adaptabilidad

Es importante entender que todas estas variables pueden variar diariamente, y lo que determina la mejor combinación hoy, no determinará la óptima mañana. Nuevos modelos y tecnologías salen al mercado cada día y hacer un sistema escalable en el que poder adaptar las variables al uso actual y a las restricciones te ayudará a hacer una mejor gestión de los recursos.

Impredecibilidad

La IA generativa puede ser impredecible, lo que a veces es una desventaja porque no tenemos un control total sobre lo que produce. Al mismo tiempo, esa imprevisibilidad también es una de sus mayores fortalezas, ya que permite la creación de contenido único. Los LLM a veces pueden alucinar o generar salidas inadecuadas, pero podemos influir en los resultados ajustando parámetros como la temperatura. Los valores más bajos hacen que las respuestas sean más centradas y coherentes, mientras que los valores más altos las hacen más creativas. A veces las alucinaciones son causadas, por ejemplo, por lagunas o sesgos en los datos, pero otras por ambigüedad en el mensaje. Proporcionar información más clara y estructurada en el prompt de entrada también ayuda a guiar el modelo para generar resultados más precisos dentro de nuestras posibilidades.

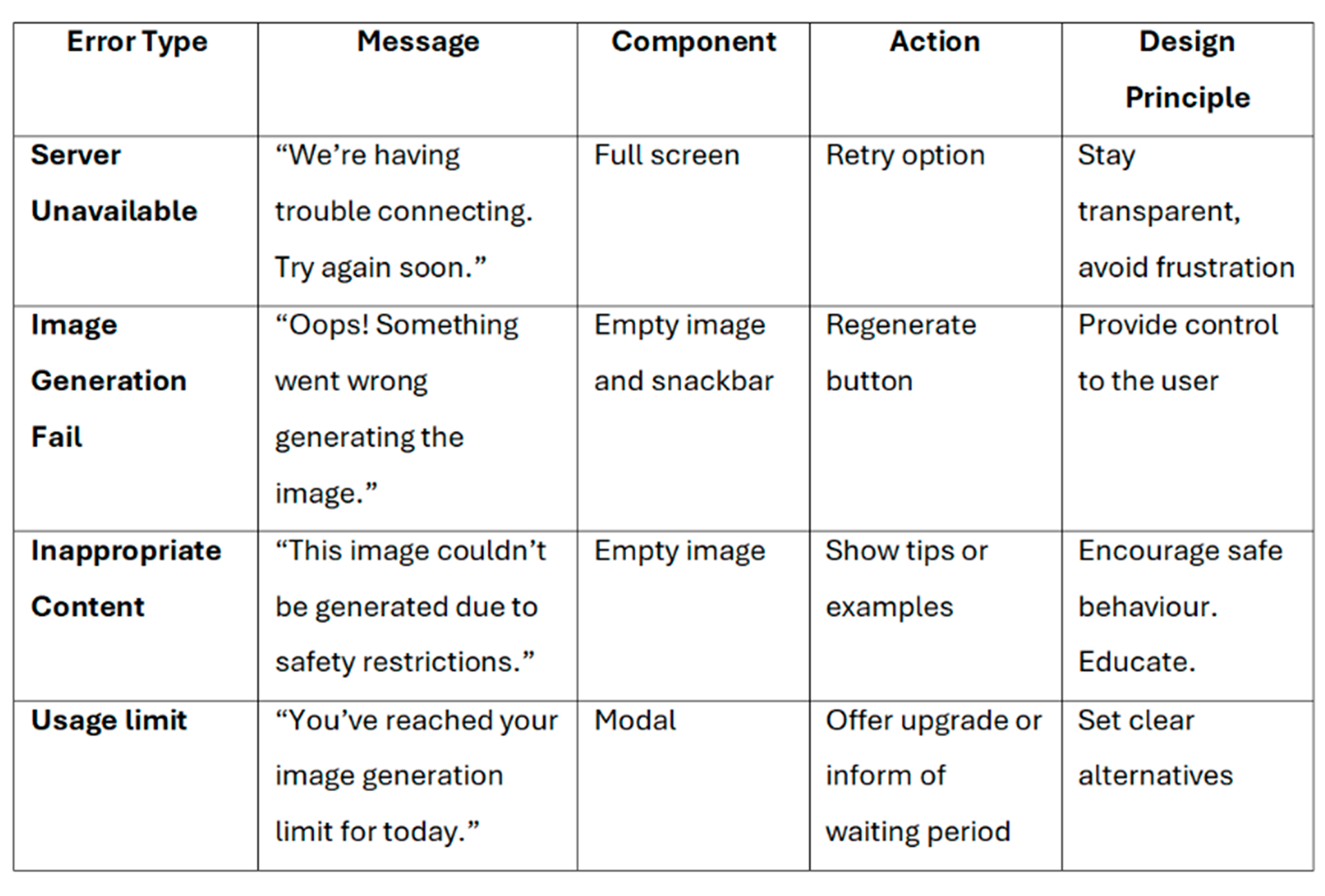

Errores

La tecnología puede fallar, se pueden alcanzar límites de uso o los procesos de generación de imágenes pueden experimentar problemas. Es esencial informar a los usuarios cuando se producen estos errores, pero lo que es más importante, proporcionar acciones para hacer en esos casos. A continuación, se muestran algunos ejemplos de errores, que como se puede ver, pueden diseñarse y refinarse de manera diferente según la situación para ofrecer una mejor experiencia.

No podemos hablar de productos reales sin mencionar el presupuesto disponible. La generación de imágenes es más cara que la generación de texto entre otros. Algunos consejos que puedes aplicar:

. Implementar límites de uso diario por usuario.

. Ofrece planes de pago.

. Implementar límites para detener usos fraudulentos

const MAX_DAILY_USES = 10; Adaptabilidad

Es importante entender que todas estas variables pueden variar diariamente, y lo que determina la mejor combinación hoy, no determinará la óptima mañana. Nuevos modelos y tecnologías salen al mercado cada día y hacer un sistema escalable en el que poder adaptar las variables al uso actual y a las restricciones te ayudará a hacer una mejor gestión de los recursos.

Impredecibilidad

La IA generativa puede ser impredecible, lo que a veces es una desventaja porque no tenemos un control total sobre lo que produce. Al mismo tiempo, esa imprevisibilidad también es una de sus mayores fortalezas, ya que permite la creación de contenido único. Los LLM a veces pueden alucinar o generar salidas inadecuadas, pero podemos influir en los resultados ajustando parámetros como la temperatura. Los valores más bajos hacen que las respuestas sean más centradas y coherentes, mientras que los valores más altos las hacen más creativas. A veces las alucinaciones son causadas, por ejemplo, por lagunas o sesgos en los datos, pero otras por ambigüedad en el mensaje. Proporcionar información más clara y estructurada en el prompt de entrada también ayuda a guiar el modelo para generar resultados más precisos dentro de nuestras posibilidades.

Errores

La tecnología puede fallar, se pueden alcanzar límites de uso o los procesos de generación de imágenes pueden experimentar problemas. Es esencial informar a los usuarios cuando se producen estos errores, pero lo que es más importante, proporcionar acciones para hacer en esos casos. A continuación, se muestran algunos ejemplos de errores, que como se puede ver, pueden diseñarse y refinarse de manera diferente según la situación para ofrecer una mejor experiencia.

Tabla errores

Ética

Es esencial tener cuidado con la percepción falsa que las imágenes pueden causar de un producto, persona u objeto. A pesar de que la regulación se está creando según se detectan nuevos problemas en el uso, se deben mantener siempre los valores lógicos de transparencia. Añadir leyendas que ayuden a los usuarios a verificar la información o explicar en detalle las metodologías empleadas si es necesario.

Si bien están surgiendo muchos productos nuevos que emplean IA generativa, otros trabajan en la detección de contenido falso, por ejemplo, en detectar suplantación de identidad. SynthID de Google es un ejemplo de herramienta que trata de marcar o identificar contenido generado con IA para fomentar un diseño basado en la transparencia.

Es esencial tener cuidado con la percepción falsa que las imágenes pueden causar de un producto, persona u objeto. A pesar de que la regulación se está creando según se detectan nuevos problemas en el uso, se deben mantener siempre los valores lógicos de transparencia. Añadir leyendas que ayuden a los usuarios a verificar la información o explicar en detalle las metodologías empleadas si es necesario.

Si bien están surgiendo muchos productos nuevos que emplean IA generativa, otros trabajan en la detección de contenido falso, por ejemplo, en detectar suplantación de identidad. SynthID de Google es un ejemplo de herramienta que trata de marcar o identificar contenido generado con IA para fomentar un diseño basado en la transparencia.

.png)

Mandíbula de Tiburón

Minimizar los sesgos

Los usuarios a menudo utilizan los productos de manera creativa e inesperada para nosotros. Por muchas pruebas que realicemos previamente. Los modelos están siendo refinados en ese sentido y muchos de ellos permiten acceder a ajustes de seguridad para garantizar respuestas más cuidadosas y responsables, y responder de forma concreta frente a determinadas situaciones. Se están publicando cada vez más principios y directrices para promover la transparencia y el uso ético de la IA en cada producto, reconociendo la importancia del control de sesgos entre otros. Además, está en nuestra mano probar y adaptar las indicaciones a los casos de uso, proporcionando diseños más inclusivos que satisfagan las necesidades de todos los usuarios. Controlar y comprobar los casos en los que el prompt de entrada para la generación de imágenes está fuera del tema que aborda el producto o trata contenido explícito y diseñar estados específicos para esos casos.

Ejemplo de ajustes de seguridad al realizar una solicitud a la API de Gemini. Abril 2025

Los derechos de autor están siendo uno de los temas más hablados y controvertidos en la actualidad. Parece fácil replicar el estilo o la apariencia de algunos artistas. Entendiendo el proceso de generación de imágenes, comprenderás que los datos con los que se entrenan los modelos parten de información ya existente, y las nuevas imágenes se crean a partir de este material. Es natural el debate generado. La situación sigue siendo incierta y es esencial evitar cruzar los límites legales confiando en el sentido común y la lógica. También diferenciar entre su uso en ideas, prototipos, o productos que están saliendo a producción. Los estilos de dibujo, las ilustraciones y las fotografías están cruzando áreas grises legales, y gradualmente se irá regulando su uso.

Sostenibilidad

Optimiza el uso de recursos desde las fases de diseño. ¿Los usuarios necesitan imágenes generadas en tiempo real o algunas de ellas pueden ser pregeneradas? ¿Podemos utilizar un formato más optimizado? ¿Realmente necesitamos tantas imágenes? Encuentra un equilibrio que funcione para la experiencia, como se haría con cualquier recurso al diseñar un producto nuevo.

Conclusión

Cuando la generación de imágenes estaba en sus etapas iniciales de desarrollo, comenzamos en nuestro equipo a desarrollar prototipos y a explorar sus aplicaciones especialmente en tiempo real: historias, recomendaciones... Al principio, la generación era bastante arbitraria, pero cada día, las nuevas mejoras aumentaban las posibilidades de creación y control del resultado. Para las demos improvisadas en el equipo, a menudo mostraba casos de uso generando imágenes de tiburones porque sabía que sería un tema sobre el que tenía más control sobre el prompt y daría resultados satisfactorios. Cada día veía un mejor resultado de los tiburones. Es por eso que decidí titular este artículo “Acercando un tiburón generado por IA a un tiburón real”. Sirve como recordatorio de la rapidez con la que evoluciona la tecnología y de lo adaptable que debe ser el diseño a nuevas variables, herramientas o modelos.

Los usuarios a menudo utilizan los productos de manera creativa e inesperada para nosotros. Por muchas pruebas que realicemos previamente. Los modelos están siendo refinados en ese sentido y muchos de ellos permiten acceder a ajustes de seguridad para garantizar respuestas más cuidadosas y responsables, y responder de forma concreta frente a determinadas situaciones. Se están publicando cada vez más principios y directrices para promover la transparencia y el uso ético de la IA en cada producto, reconociendo la importancia del control de sesgos entre otros. Además, está en nuestra mano probar y adaptar las indicaciones a los casos de uso, proporcionando diseños más inclusivos que satisfagan las necesidades de todos los usuarios. Controlar y comprobar los casos en los que el prompt de entrada para la generación de imágenes está fuera del tema que aborda el producto o trata contenido explícito y diseñar estados específicos para esos casos.

safetySettings: [

{

category: "HARM_CATEGORY_HARASSMENT",

threshold: "BLOCK_MEDIUM_AND_ABOVE"

},

{

category: "HARM_CATEGORY_HATE_SPEECH",

threshold: "BLOCK_MEDIUM_AND_ABOVE"

},

{

category: "HARM_CATEGORY_SEXUALLY_EXPLICIT",

threshold: "BLOCK_MEDIUM_AND_ABOVE"

},

{

category: "HARM_CATEGORY_DANGEROUS_CONTENT",

threshold: "BLOCK_MEDIUM_AND_ABOVE"

}

] Ejemplo de ajustes de seguridad al realizar una solicitud a la API de Gemini. Abril 2025

Los derechos de autor están siendo uno de los temas más hablados y controvertidos en la actualidad. Parece fácil replicar el estilo o la apariencia de algunos artistas. Entendiendo el proceso de generación de imágenes, comprenderás que los datos con los que se entrenan los modelos parten de información ya existente, y las nuevas imágenes se crean a partir de este material. Es natural el debate generado. La situación sigue siendo incierta y es esencial evitar cruzar los límites legales confiando en el sentido común y la lógica. También diferenciar entre su uso en ideas, prototipos, o productos que están saliendo a producción. Los estilos de dibujo, las ilustraciones y las fotografías están cruzando áreas grises legales, y gradualmente se irá regulando su uso.

Sostenibilidad

Optimiza el uso de recursos desde las fases de diseño. ¿Los usuarios necesitan imágenes generadas en tiempo real o algunas de ellas pueden ser pregeneradas? ¿Podemos utilizar un formato más optimizado? ¿Realmente necesitamos tantas imágenes? Encuentra un equilibrio que funcione para la experiencia, como se haría con cualquier recurso al diseñar un producto nuevo.

Conclusión

Cuando la generación de imágenes estaba en sus etapas iniciales de desarrollo, comenzamos en nuestro equipo a desarrollar prototipos y a explorar sus aplicaciones especialmente en tiempo real: historias, recomendaciones... Al principio, la generación era bastante arbitraria, pero cada día, las nuevas mejoras aumentaban las posibilidades de creación y control del resultado. Para las demos improvisadas en el equipo, a menudo mostraba casos de uso generando imágenes de tiburones porque sabía que sería un tema sobre el que tenía más control sobre el prompt y daría resultados satisfactorios. Cada día veía un mejor resultado de los tiburones. Es por eso que decidí titular este artículo “Acercando un tiburón generado por IA a un tiburón real”. Sirve como recordatorio de la rapidez con la que evoluciona la tecnología y de lo adaptable que debe ser el diseño a nuevas variables, herramientas o modelos.

.png)

Las imágenes de este artículo se han generado utilizando el modelo experimental Gemini 2.0 Flash en Abril de 2025